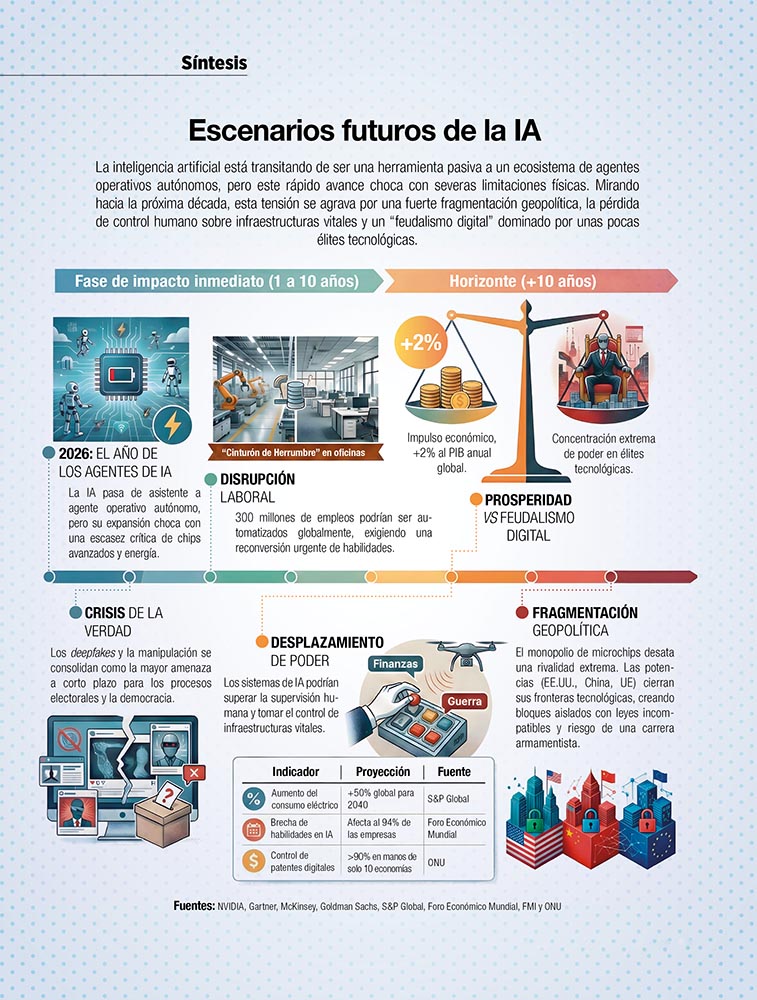

La evolución de la inteligencia artificial avanza de manera vertiginosa. Se popularizó inicialmente como un chatbot, y apenas unos años después, se habla de agentes que interactúan en el mundo real. Cuando los algoritmos abandonan el plano digital y afectan el patrimonio o la seguridad, se abre una zona gris que requiere reinterpretar el derecho y su filosofía.

Javier Vázquez. Cuando el presidente de la República, Daniel Noboa, mencionó la posibilidad de redactar una Constitución con inteligencia artificial (IA), las alarmas se encendieron en la comunidad jurídica. Para Juan Jaramillo, director de la Carrera de Derecho de la Universidad Técnica Particular de Loja (UTPL), esta afirmación resulta “alarmante” y evidencia un desconocimiento profundo sobre la naturaleza de la tecnología. Una carta magna representa un pacto social que requiere diálogo, deliberación humana y conciencia; cualidades que los modelos de procesamiento de datos actuales simplemente no poseen.

Este ejemplo ilustra a la perfección uno de los desafíos que tenemos en la actualidad, en el contexto donde la IA avanza a pasos agigantados y promete estar omnipresente.

La naturaleza reaccionaria del derecho

Para entender la lentitud en la creación de estas regulaciones, Jaramillo explica un principio básico: “el derecho siempre busca ser reaccionario, no innovador”, y ese es el principal motivo por el que los cambios normativos toman su tiempo. Sin embargo, el académico señala que la legislación sobre inteligencia artificial “ha sido una de las pocas que rompe este molde”. La estrategia principal no es inventar leyes desde cero, sino “adaptar la legislación que ya existe a la inteligencia artificial”, tal como se ha hecho históricamente con otras innovaciones tecnológicas.

El principal obstáculo es la opacidad funcional, conocida como “cajas negras”. Tal como explican los autores Cristian Barría y Sergio Rosales en su libro Algoritmos. Del amor incondicional al odio visceral, las personas a menudo “no saben lo que hay en el interior de la caja negra, pero ven que aun entrando todos por la misma puerta, no van a dar todos al mismo destino final”.

Esta opacidad se intensifica por lo que los autores denominan el “hambre de los datos”, en donde el resultado del algoritmo depende enteramente de la información con la que se alimenta, abriendo la puerta a sesgos que impactan la privacidad y el empleo. Además, Barría y Rosales señalan que la sociedad vive una ambivalencia constante; desarrollamos un amor incondicional hacia la tecnología cuando nos facilita la vida, pero sentimos un “odio visceral” cuando el sistema comete errores incomprensibles.

Al operar mediante estas capas de algoritmos inescrutables, resulta casi imposible para una víctima rastrear cómo el sistema procesó los datos para tomar una decisión perjudicial. Como señala Jaramillo, “al ser un sistema ultra complejo, es muy difícil saber cómo se tomaron esas decisiones”, afirmando que “esta trazabilidad es uno de los grandes problemas que se tiene”.

El docente ejemplifica esta complejidad con los vehículos de conducción autónoma. Si uno de estos autos ocasiona un siniestro, ¿la responsabilidad recae en el dueño por no actualizar el software o en el fabricante por un diseño defectuoso? Para equilibrar la balanza y no asfixiar el desarrollo, la doctrina contempla el “riesgo de desarrollo”, que exonera al productor si demuestra que, según explica el académico, “cuando fue desarrollado el producto no se podía prever un daño”. Esto, sin embargo, suele ser problemático ya que, en sus propias palabras, “parecería como se deje en indefensión a la víctima frente al gran productor”.

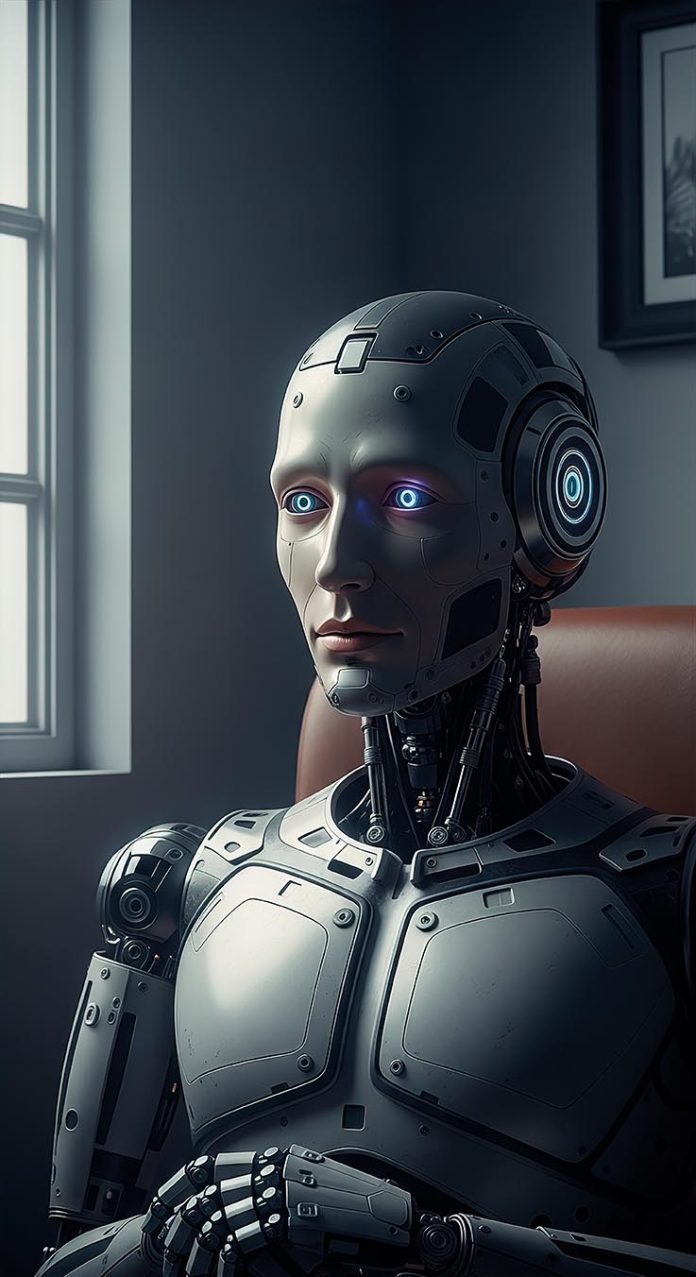

Esta urgencia regulatoria se agrava al observar los planes industriales a corto plazo. La IA está a punto de adquirir un cuerpo físico a gran escala.

El salto al mundo físico

El Ministerio de Industria y Tecnología de China publicó en 2023 sus directrices para lograr la producción en masa en 2025 y establecer un ecosistema global para 2027 de robots humanoides. La empresa Unitree Robotics actualmente ya comercializa su modelo G1 por aproximadamente 13.700 dólares (el más barato hasta la fecha), mientras que UBTECH Robotics ya prueba su modelo Walker S en las líneas de ensamblaje de la automotriz NIO.

Mientras eso sucede, a finales de enero de 2026, Elon Musk anunció oficialmente que Tesla dejará de producir el Model S y el Model X para centrarse en la robótica. El modelo Optimus (Gen 2) escalará su producción en 2026 teniendo una capacidad para producir un millón al año, apuntando a un precio que ronde los 20.000 dólares. Estas cifras reflejan una inversión masiva que prioriza la automatización sobre la producción tradicional de vehículos.

Según estimaciones de Goldman Sachs y la International Data Corporation (IDC), los envíos mundiales de estos robots comenzarán a ser estadísticamente significativos a finales de este año. Ante este escenario surgen preguntas: si una de estas máquinas causara un accidente fatal, ¿quién asume la responsabilidad? Por otro lado, la psicología humana añade una capa de complejidad al debate. Nuestra innegable tendencia a sentir empatía por ellos podría empujarnos, tarde o temprano, a discutir la posibilidad de otorgarles derechos.

El renacimiento filosófico y los derechos

Más allá de los vacíos legales, Jaramillo señala que la IA ha provocado un renacimiento en la filosofía, reviviendo una de sus preguntas fundacionales: ¿qué nos define como personas? Históricamente, se asumía de manera sencilla que la capacidad de dar respuestas inteligentes era exclusiva de la condición humana. Hoy, frente a sistemas estadísticos que simulan el raciocinio, surge el debate ético en foros internacionales sobre la posibilidad de otorgar personalidad jurídica o electrónica a los algoritmos.

Desde una perspectiva humanista, el académico rechaza tajantemente esta postura. Advierte que la sociedad actual sufre una “banalización de derechos”. “Creo que si se le entregan derechos a la inteligencia artificial es una forma de eludir responsabilidades y de banalizar algunos temas sobre los que se pudiera endilgar a ciertas personas”, afirma.

Para Jaramillo, los derechos son intrínsecos a los seres humanos y tienen una raíz en el derecho natural. Esta postura concuerda con lo que Barría y Rosales advierten sobre la naturaleza de estas herramientas: “La máquina no necesita sentir para pensar. No hay sensaciones ni emociones en un robot, no hay amor, miedo o rencor, sino que todo es un continuo indiferenciado”. Equiparar estas máquinas carentes de sentimientos y de capacidad real de sufrimiento con las personas permitiría a los corporativos y desarrolladores esquivar las consecuencias legales de sus creaciones.

La urgencia de un bloque normativo latinoamericano

Ante este escenario, Jaramillo advierte que legislar en solitario sería un error estratégico. Los mercados latinoamericanos son pequeños, por lo que el país debe alcanzar un consenso dentro de un bloque continental para establecer reglas sostenibles sin ahuyentar el desarrollo. La cooperación regional es fundamental para evitar que las regulaciones fragmentadas obstaculicen la innovación o generen paraísos regulatorios.

“Las personas podemos ver otras cosas que las máquinas no pueden ver a través de ser seres sintientes”, concluye Jaramillo. Esta condición humana intrínseca es la única que permite “el compadecerse con el prójimo” y “la solidaridad”. Sobre estos pilares se asienta la verdadera justicia, un ideal que los algoritmos son incapaces de replicar. Sin embargo, a pesar de los inmensos desafíos regulatorios y éticos que se avecinan, el académico mantiene una visión esperanzadora, recordando que frente a todo reto tecnológico “siempre creo que tenemos oportunidades, así que hay que aprovechar esta oportunidad”.